산업 전반에 생성형 인공지능(AI)이 침투하는 가운데 AI 언어 모델 운영에 들어가는 막대한 비용과 전력은 최대 난제로 꼽힌다. 이에 정보기술(IT) 업계는 언어 모델 경량화와 저전력 하드웨어에 눈을 돌리고 있다. IT 기업 관계자는 21일 “모든 기업이 챗GPT와 같은 생성형 AI를 만들어 적용할 필요는 없다는 공감대가 커지고 있다”고 말했다.

미국 시장조사 업체 밸류에이츠리포트는 파라미터(매개변수) 수십억개의 소형 언어 모델(SLM) 시장 규모가 지난 2022년 51억8000만 달러(약 7조1400억원)에서 오는 2029년 171억8000만 달러(약 23조6800억원)에 이를 것으로 전망했다.

국내외 테크 기업에선 기존 거대 언어 모델(LLM)보다 크기가 작은 언어 모델을 잇달아 내놓고 있다. 구글이 지난해 말 출시한 SLM ‘제미나이 나노’는 삼성전자 갤럭시 S24 시리즈 등에 탑재됐다. 제미나이 나노는 두 가지 버전으로, 매개변수가 각각 18억개와 32억5000개다. 메타가 지난 18일(현지시간) 공개한 최신 AI 모델 ‘라마3’는 매개변수가 700억개인 대형 모델과 80억개인 소형 모델 등으로 나뉜다.

삼성전자 자체 AI 모델 ‘가우스’의 매개변수는 공개되지 않았지만, 가우스를 경량화한 모델이 갤럭시 S24 시리즈에 들어갔다. LG전자는 국내 AI 스타트업 업스테이지가 개발한 SLM ‘솔라’를 기반으로 온디바이스 AI 기술 개발에 나섰다.

하드웨어인 AI 반도체에선 전력 효율과의 싸움이 한창이다. 삼성전자는 추론에 특화된 AI 반도체 ‘마하-1’을 개발 중이다. 전 분야의 데이터를 학습해 사용자가 원하는 답변을 제공하는 LLM은 학습과 추론을 모두 수행하는 반도체가 필요하다. 엔비디아의 그래픽처리장치(GPU)가 이에 해당한다. 그러나 SLM은 한정된 데이터로 추론만 할 수 있어도 충분한 경우가 많다. 추론만 하면 소비 전력은 줄어든다. 삼성전자는 마하-1의 전력 효율을 기존 AI 반도체보다 8배 높일 방침이다. 마하-1에는 업계 최고 동작 속도의 저전력 D램인 ‘LPDDR5X’가 들어갈 전망이다.

SK하이닉스는 대만 TSMC와 손잡고 6세대 고대역폭메모리(HBM4) 공동 개발에 나섰다. HBM4 개발에서도 전력 효율을 높이는 건 중요한 과제다. SK하이닉스는 초미세 공정을 적용한 HBM4로 성능과 전력 효율 면에서 고객사들의 요구에 부합하는 HBM을 생산할 계획이다.

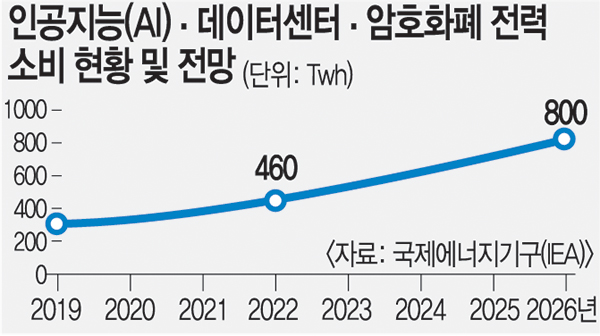

업계는 전력과 비용 절감 없는 생성형 AI 기술은 지속 불가능하다고 입을 모은다. 국제에너지기구(IEA)는 오는 2026년 AI와 데이터센터, 암호화폐 등 미래 기술 활용에 따른 전력 수요가 800Twh(테라와트시)에 달할 것으로 본다. 독일과 스웨덴의 전력 소비량을 합친 수준이다. 챗GPT의 LLM인 GPT의 운영비는 하루에 70만 달러(약 9억6000만원) 이상으로 알려졌다.

조민아 기자 minajo@kmib.co.kr

GoodNews paper ⓒ 국민일보(www.kmib.co.kr), 무단전재, 수집, 재배포 및 AI학습 이용 금지